【さらに妄想が強めのエリアに進入します】

■第2章 妄想ストーリーと絡められないだろうか。

ついにイブノイルを動かすことに成功した(管)。

妄想は広がるばかりである。

--------------

Live2Dはアニメーションの作成だけでなく、ゲームなどの組み込みを想定しているためSDK(ソフトウェア開発キット)が充実しているらしい。

最近いろんな税的な意味で話題になった「Unity」から、iOSやPS5まで、様々な基盤との連携に対応している。

個人でいきなり「オススメオンライン 蝕世のイブノイルの幻影呪縛」とかAAAタイトルを目指すと、人類が地球を脱出する頃にリリースできるかどうかくらいになるため、大変である。

せめてサウンドノベルっぽいものができないかなあ・・・・・・と思い、

Unity向けに出力してみたものの・・・・・・動きはするが、メッセージを表示させるなどは自力で実装しなければいけないため、これまた作っているうちに人類が地球を脱出しそうである。

※一応、Unity向けのビジュアルノベルツール「宴」というものがあるが、88ドルするため気軽に試すにはハードルが高い。また宴自体はLive2Dと連携しているわけでもない。

そんな中「ティラノスクリプト」という、マルチプラットフォーム対応でLive2Dとも連携している無償の「ノベルゲーム開発ツール」があることを知る。

(恐竜・・・?)

これが非常に分かりやすい仕様で、UnityみたいにC#(プログラミング言語)を使いこなす必要はなく、簡単なタグで制御してくれるステキな代物である。

おまけにLive2Dを連携できる「Live2D 公式プラグイン Cubism4対応版」がリリースされている。これもまた無償である。素晴らしい・・・!

「ティラノスクリプト」を試してみようじゃないか・・・!!

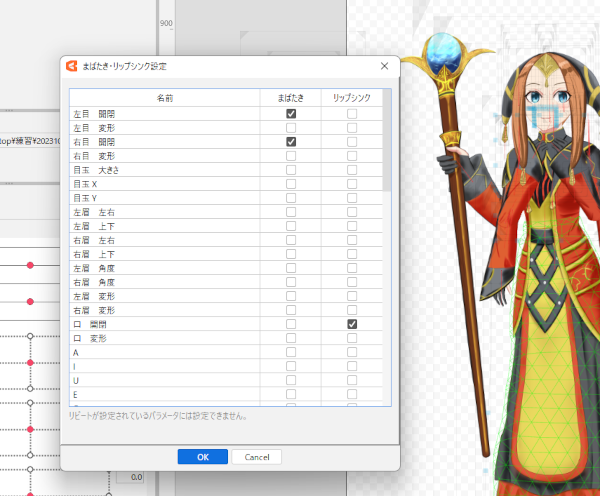

まずは事前準備として、自動でまばたきしてくれるように、「まばたき」と、テキストや音声に合わせて口の開閉を制御してくれる「リップシンク」をLive2Dで設定する。

※Live2DのV5では音声の母音に合わせた口の開閉を制御する「モーションシンク」が実装されているが、ティラノスクリプト側がV4対応で非対応のためまだ使用できない。いずれは利用できるようになるかもしれない。

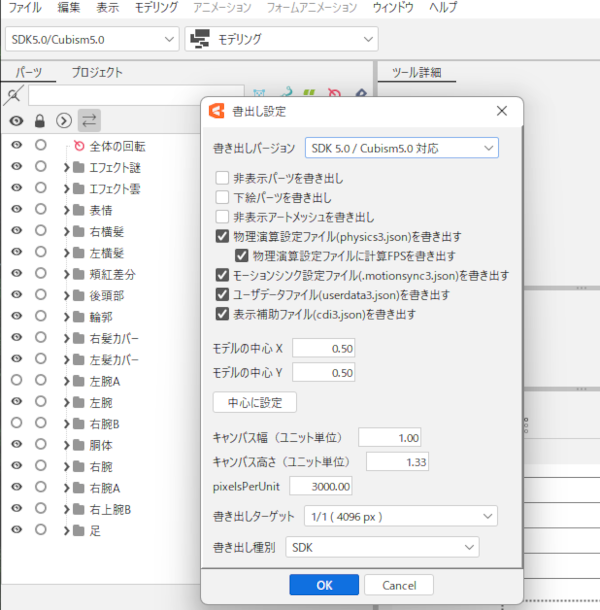

これをなんかそのままSDK用のファイルとして書き出し・・・

※ティラノスクリプト側はV4対応だが、V5対応で書き出しても特に動作に影響はなかった。

(なんかいろいとやってるけど読み飛ばして下さい)これをLive2DのViewerでロードし、千手観音状態にならないように、必要な時に必要な腕のみが出るようにグループNoを設定し・・・

※「Parent ID」を設定するとティラノスクリプトでロードする際にモデル自体が表示されない状態になったため、使用しない方がよさそう。

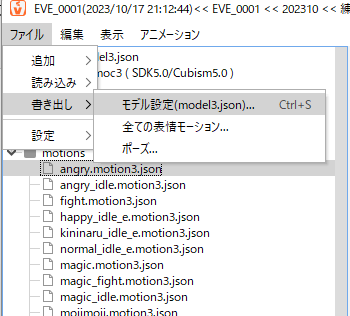

作成したモーションに、グループ名を設定し

定義ファイルを保存したら万事OK!!!

モデルとモーションの設定が終わったので、次はティラノスクリプト側の作業。

単にイブノイルを表示するだけであれば非常に簡単で

[plugin name="live2d"]

[live2d_new name="EVE_0001" model_id="EVE_0001" jname="イブノイル"]

[live2d_show name="EVE_0001" y=-0.8 x=0 scale=2.5]

のたった3行である。

表示された!!

しかも、さきほどのモーションのグループ名に「Idle」と指定したモーションをアイドルモーション(キャラが何もやってないときに動いてるモーション)としてランダムに動かしてくれているので楽である。

背景は以前に描いたこれを使うと丁度いいだろう・・・!!丁度いいじゃん!!!

これでモーションとセリフを組み合わせて完成・・・・・・!!

タイトルは何にも抵触しないように「オススメモリアル -伝説の宮殿の下で-」にしよう。

だが、動かしてみると何かが足りないような気がする・・・・・・

そうだ、音声とBGMだ!!!

イブノイルはこれまでもこれからも、おそらく声が割り当てられることはないだろうと思うので、幾分やり易い。

ただ、いくらDIYとは言えど、自分でやる(あえての地声か、ボイスチェンジャー)は、なんか違う気がする・・・・・

また、ワイの考えた脳内オススメモリアルの声をやってくれ!と誰かにお願いするのは、とても申し訳ない気がする。

(無償で声優でも何でもない人に、ワシが考えた脳内セリフを喋ってもらうのも、人道的にどうだろう・・・)

かと言って有償の読み上げソフトってのも違う気がする・・・

悩ましい・・・

いろいろ探していると、こんなものがあるのを発見した。

「COEIROINK」・・・・・!!!

いわゆる無償の合成音声読み上げソフトではあるのだが、このソフトの特徴としては

「自分の声」を学習元データとして、音声合成用のツールに学習させ、自分の声をベースとした音声モデル(入力したテキストに応じて自分の声で音声を生成できる出力結果)を作成することができるらしい・・・!!(MYCOEIROINKという)

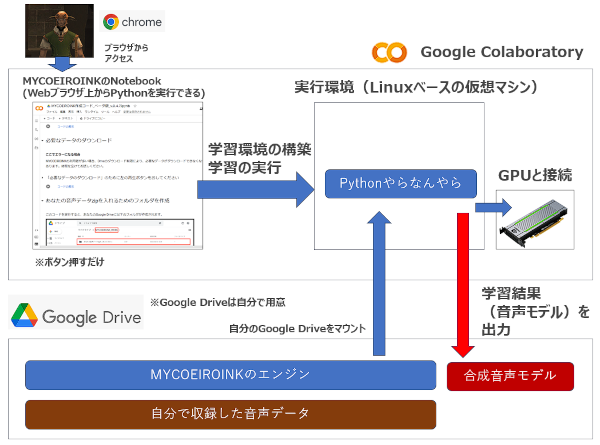

※仕組みはこの辺が参考になります。ディープラーニング技術を使用した音声合成の仕組み。

一般的に、AI関連技術を使用した学習、および出力したモデルを使用するためのツールは

GPU・・・いわゆるグラボのパワー(処理性能およびGPUのメモリ)を非常に要求されるため、環境を準備するだけでもそこそこ費用がかかってしまう。

最低でもこれくらいは欲しい・・・・・・

また各種ツールをインストールして設定して・・・ということをする必要があるので、手間がかかる・・・

しかし有難いことに「MYCOEIROINK」では「Google colab」上で動作するノートブックが使用できるのでWebブラウザ上の操作だけでモデルを作成することができる・・・!

・・・・・・・。。

つまり大体こういうことか・・・!!!

GPUも実行環境も、Google Colabの無償枠を使えば合成音声モデルの作成ができる。

これで音声を自作できれば、さらにDIY感が増すような気がする!!

これなら自分が考えた脳内セリフを、誰かに演技してもらう罪深さが軽減されるし良いのでは!?

さて、音声モデル作成のためには学習元データが必要なわけですが、誰か声を入れてくれる人は・・・・・・・

(家の中で目が合う)

「・・・・・・やってみようじゃないか・・・!!」

さすが先生!!!

合成音声モデルの作成という「人体実験」に参加していただきありがとうございます。

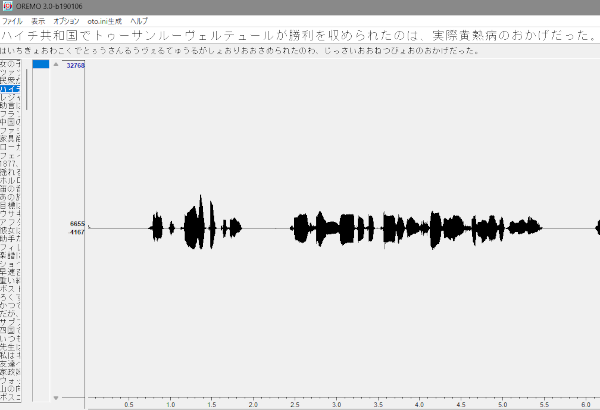

で、どのくらいの音声を収録すればいいかというと・・・

「652文・・・・・・。」

最低は10文でいいそうだが、精度の高いモデルを作成するには多い方がいいが・・・

「・・・・・・やってみようじゃないか・・・!!」

さすが先生!!!

こうしてマイク片手に先生の奮闘が始まった・・・!!

一つの文は短いのだが、なにせ量が多い・・・・・・。

「自分のデータを作り出すのは、なんか星新一の世界だな・・・」

「そうだな・・・・・・」

ものすごい未来感がするが、作業自体はとても地味である。

・・・解説サイトを参考に、収録すること数日・・・

ついに収録完了・・・!!

Google Colabで学習開始だ・・・!!

ガイドによると、このモデル(epoch)が50以上まで生成されると

精度のいいデータになるようだが・・・・・

放置すること数時間

ギャアアアアアア!!!セッション(学習)が途中で勝手に終わっている・・・!!!

Google Colabは無償でGPUを使用できるものの・・・そこは無償の宿命で

一定時間使用すると、再びGPUを使用できるようになるまで半日から1日程度かかるらしい・・・

まだ5epochも進んでいないというのに・・・

このままではモデルを作るだけで1週間はかかるな・・・

おれは課金するぜ・・・!!(100コンピューティング単位を買いました)

コンピューティング単位というのはGPU使用権のようなもので、通常のGPU(2023年10月現在はNVIDIA Tesla T4)であれば、使用した感じ50epochのモデルを2つ作れる量のようだ。

1時間で2epoch程度なので気長に流し続けるしかない。

--数日後--

ついにここまで来た・・

コンピューティングを買ってもセッションが永続するわけではないが(3時間くらいで切れる)、待たなくていいのはマシか・・・・・・(苦しみながら

さて、モデルのデキ具合の確認として、「母の声を聞くことにかけては、この道1X年の子ミスラ」に聞かせてみる。

「こ、これは・・・母ちゃんそのもの!母ちゃんに怒られている・・・・・・!」

精度は高いようです。

ただ、文の読み上げがいつも通りすぎたために、このままいくとイブノイルのサウンドノベルを作るというより、生命工学で肉体を準備する方に進んでしまいそうなので、、撮りなおした方がいいのではということになった。

(イブノイルは1万歳以上の熟女だからそのままでもいいって説もあるが)

音声を撮りなおし再び学習させること数日・・・・・・

遂に音声モデル完成!!

ていうか普通に喋ってもらった方がはるかに手間はないのだが、もはやこれは狂気。マッドサイエンティストである。

セリフを入力してティラノスクリプトに設定していく。

ティラノスクリプト側ではテキストだけでなく、音声もリップシンクに対応しているので自然に見えるはずである。

----------------

さて最後にBGMだが・・・・・・やはりこの場所はアレだからアレを使った方がいいのだろうが、 さすがにそのままってのも。。。どうしようかなぁ・・・・・・

部屋の中を見渡す。

そこにいたのは・・・・!!!!!!!!!

「オ、オタマトーン・・・!!!!」

「・・・・・・やってみようじゃないか・・・!!」

さすが先生!!!

先生はトロンボーンおよびベース経験者ということで、オタマトーンを奏でるのに十分な音楽的素養が?ある?はず?

これならきっとアレを演奏してくれるはず・・・!!

「それにしても・・・・・・これでトゥー・リアを・・・??」

『3回くらい練習したし。』

・・・・・・そ、そうなんだ・・・。

ついに全てが集結したオススメモリアル・・・!

妄想が形に!

その出来栄えはいかに!?

※サウンドをオンにしてみてください。

※30秒で終わります。多少の表示バグがあるのは気にしない!!自由にプレイして、あとは自由に解散してください。先生からは以上です。